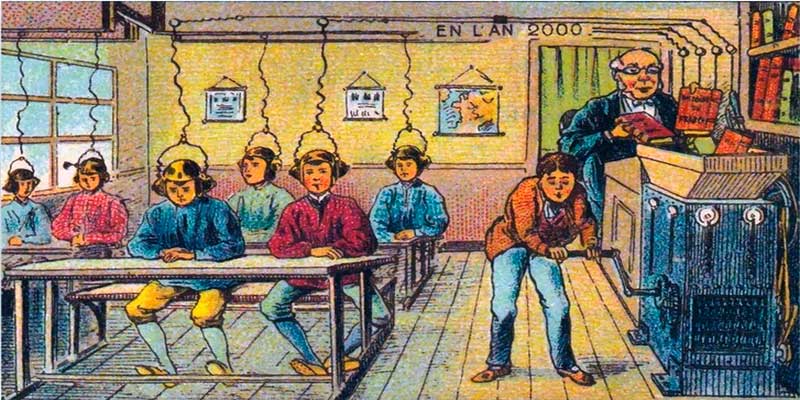

Ilustración: «Escuela del Futuro», de Jean-Marc Côté ©1890

Pensemos en las limitaciones de aprender con la IA. La irrupción de las herramientas de inteligencia artificial (IA) como ChatGPT, Gemini, Perplexity, DeepSeek o Copilot ha reavivado un debate histórico: ¿pueden las máquinas sustituir a los educadores en el proceso de enseñanza?

Con el aumento exponencial de publicaciones en redes como Linkedin o Facebook que ofrecen «prompts milagrosos» para crear desde cero cursos de formación completos, lecciones específicas, materiales didácticos o recursos pedagógicos para aprender cualquier cosa que se le ocurra «al usuario» comienza a formarse la sobrestimación del autodidactismo.

Tanta propuesta para crear diseños instruccionales a partir de un prompt que se planta en la ventana de un LLMs (Large Language Models o Modelos Lingüísticos Grandes) capaces de desarrollar cualquier competencia profesional a demanda, debería motivar esta reflexión: ¿la IA podrá satisfacer necesidades de aprendizaje, con solo saber elaborar el prompt apropiado que describa la competencia que quiere aprender, que tipo de ejercicios prácticos le gustaría realizar para consolidar lo aprendido, cuanto tiempo dispone para dedicar al estudio, en que ámbito profesional aplicará lo aprendido y detalles sobre la experiencia previa del estudiante?

El enfoque de la didáctica basada en prompts asume que los usuarios tienen habilidades cognitivas para autorregular sus procesos aprendizaje, definir objetivos realistas y mantener la disciplina de estudio y práctica. Sin embargo, esto solo aplica a una minoría:

El autodidacta exitoso no es la norma, sino la excepción. La mayoría de los estudiantes necesita estructuras externas, responsabilidad y estímulos sociales.

La IA no ofrece procedimientos pedagógicos para sostener el compromiso a largo plazo. Un programa automático no ajustará su estrategia si el usuario pierde interés o enfrenta bloqueos creativos.

Aunque los algoritmos prometen personalización, eficiencia y acceso universal, su capacidad para funcionar en la complejidad del aprendizaje humano sigue siendo una quimera.

La idea que la IA puede estructurar contenidos y actividades didácticas en los plazos y con los recursos apropiados para aprender es un espejismo que deforma a la realidad.

Por ejemplo, un profesional que quiere aprender análisis de datos en tres meses podría solicitar: «Diseña un programa de 12 semanas para aprender a analizar datos con ejercicios en Python, dos horas diarias, enfocado en aplicaciones en salud pública»; o incluso una instrucción mucho más «completa» como este prompt de aprendizaje multipropósito publicado en Linkedin.

La IA, tras procesar el prompt, va a generar descripciones teóricas, ejemplos prácticos y hasta simulaciones de casos reales. Plataformas como ChatGPT o Gemini ya ofrecen esto en forma experimental.

Según sus defensores, esto democratiza el acceso a educación de calidad, sin depender de instituciones. No obstante, lo que podemos llamar la «Educación Algorítmica» ignora factores didácticos claves que aquí propongo revisar. Serán muy apreciados y útiles vuestros comentarios, aportes y reflexiones.

Este artículo explora tres límites fundamentales de la llamada «didáctica artificial», entre la IA y el aprendizaje:

- La ausencia de intuición contextual,

- La incapacidad para gestionar la dimensión emocional del aprendizaje, y

- La reproducción acrítica de los sesgos culturales.

La ausencia de intuición contextual

La IA opera bajo «lógicas lineales»: input (prompt) → output (plan de estudios, o lección, o recurso didáctico, o ejercicio). Pero el aprendizaje humano es no lineal, sino que es iterativo y emocional.

Al reducir las necesidades de aprendizaje a variables cuantificables (temas, ejercicios, duración) se omiten las dimensiones críticas como la motivación intrínseca, la capacidad de autorregulación y las barreras cognitivas no conscientes.

Ejemplo: un alumno pide un curso de estadística con ejercicios prácticos. La IA va a proponer solucionar problemas técnicos, pero no detectará si el usuario tiene ansiedad matemática o necesita analogías contextualizadas a su campo laboral.

La IA no pregunta «¿por qué te cuesta aprender?», sino «qué más quieres hacer».

Un educador experto no solo transmite información, sino que adapta su enfoque didáctico según el singular contexto del estudiante: su bagaje cultural, sus representaciones sociales, sus experiencias previas e incluso su estado anímico durante la clase. La IA, en cambio, opera mediante correlaciones basadas en datos masivos.

Por ejemplo, si un alumno comete un error en un ejercicio de álgebra, un profesor podría identificar si el problema deriva de una mala base conceptual, de distracciones personales o de una metodología de enseñanza inadecuada. Un sistema de IA, por más avanzado que sea, se limitará a ofrecer una explicación genérica o a repetir ejemplos similares, sin profundizar en las causas subyacentes.

El aprendizaje efectivo requiere diálogo, retroalimentación contextualizada y ajustes en tiempo real. Un tutor humano identifica malos entendidos, adapta explicaciones y ofrece apoyo emocional.

Aunque la IA genera respuestas coherentes, carece de empatía y de la capacidad para interpretar señales no verbales o subtextos; es decir, las actuales herramientas de IA no pueden reemplazar la «intuición pedagógica», esencial para guiar a los estudiantes en sus zonas de desarrollo próximo («ZDP» Lev Vygotsky, ©1931)).

En un experimento con tutorías programadas con IA para estudiantes de secundaria («Los Grandes Desafíos de la IA para la Educación», ©2021), se observó que el 68% de los usuarios abandonaron las plataformas de elearning antes de 12 semanas, alegando que las explicaciones «no conectaban con sus dudas reales».

Dimensión emocional: más allá de los datos

El proceso de aprendizaje en los humanos está intrínsecamente ligado a la motivación, la frustración, la curiosidad y la resiliencia. Herramientas como los chatbots educativos pueden simular empatía mediante frases preprogramadas («¡Vas bien!»), pero carecen de la capacidad para:

- Detectar señales no verbales como el tono de la voz o el lenguaje corporal.

- Generar confianza a través de relaciones interpersonales duraderas entre educadores y estudiantes.

- Acompañar en crisis de autoestima o bloqueos cognitivos y facilitar la adecuación de los conceptos a las preferencias de estilos de aprendizaje

La psicóloga educativa Anna Lembke (©2022) advierte que la automatización excesiva del aprendizaje podría generar «desconexión pedagógica», donde los estudiantes perciben la enseñanza como una transacción técnica, y no como un proceso de crecimiento integral.

Sesgos y homogenización cultural

Los modelos de IA se entrenan con datos masivos que reflejan patrones de las culturas dominantes con preponderancia academicista anglosajona. Esto puede llevar a respuestas estandarizadas, invisibilizando perspectivas locales o regionales, enfoques interdisciplinares o metodologías innovadoras menos difundidas.

El uso irreflexivo de la «IA» como plataforma de autoaprendizaje tiene que saber reconocer el riesgo del llamado «colonialismo educativo» de las herramientas globalizadas que refuerzan paradigmas hegemónicos, marginando saberes significativos en el ecosistema institucional y la ecología social del estudiante.

En este sentido, los datos con los que se entrenan a los modelos de IA reflejan desigualdades estructurales. De manera tal que un sistema de tutoría artificial, por ejemplo, podría:

- Priorizar metodologías de enseñanza anglosajonas, ignorando enfoques comunitarios regionales de Iberoamérica, Asia, África u Oceanía.

- Reforzar estereotipos de género como sugerir «carreras técnicas para hombres» o «áreas sociales para mujeres».

- Excluir variantes lingüísticas no hegemónicas como dialectos étnicos o lenguas minoritarias.

Un informe de la UNESCO (2023) alertó que el 92% de los contenidos generados por IA en educación provienen de fuentes en inglés, lo que marginaliza perspectivas locales y saberes tradicionales.

El prompt perfecto no garantiza el aprendizaje exitoso

La enseñanza requiere competencias que, por ahora, siguen siendo habilidades exclusivamente humanas: ética, creatividad, empatía y adaptabilidad.

Aunque la IA es un recurso valioso para el aprendizaje autodirigido, no sustituye la complejidad de la educación formal ni el rol de los educadores en cuanto siempre van a funcionar como conectores dinámicos entre conocimientos, vocaciones, oportunidades y desafíos que no están sujetos a los parámetros matemáticos de los algoritmos por la sencilla razón que son cuestiones humanas sujetas a múltiples factores subjetivos, emocionales, psicológicos y culturales impredecibles.

Necesitamos innovar con ilusión, aunque sin ilusionismos. El camino está en integrar la IA como herramienta de apoyo para enseñar, no como el motor para aprender.

Los sistemas educativos deben priorizar la formación en pensamiento crítico y la metacognición, para que los estudiantes (también los profesores) sepan usar a la IA de manera reflexiva conscientes de sus límites.

En definitiva, elaborar el «prompt perfecto» no garantiza el aprendizaje exitoso. La educación sigue siendo, ante todo, un proceso humano, social y profundamente contextual.